Hon Hai研究所が推論機能を備えた従来の中国語LLMを発表

AI研究センターによる最初のバージョンは、数学と推論で優れた性能を発揮しています。

台北、2025年3月11日/PRNewswire/ -- Hon Hai研究所は本日、台湾のAI技術の発展において新たなマイルストーンを打ち立てる、初の繁体字中国語大型言語モデル(LLM)の発表を行いました。このモデルは、より効率的で低コストなモデル訓練方法を用いてわずか4週間で完成しました。

Hon Hai・テクノロジー・グループ(「フォックスコン」)(TWSE:2317)によって支援されているこの研究所は、世界最大の電子機器メーカーであり、主要な技術ソリューションプロバイダーであると述べ、コードネーム「FoxBrain」のLLMは将来的にオープンソース化され、一般に公開される予定であると発表しました。元々、グループの内部システムで使用されるアプリケーション向けに設計されており、データ分析、意思決定支援、ドキュメントコラボレーション、数学、推論と問題解決、コード生成などの機能をカバーしています。

FoxBrainは強力な理解力と推論能力を示すだけでなく、台湾ユーザーの言語スタイルにも最適化されており、数学的および論理的推論テストで優れたパフォーマンスを発揮します。

「最近数ヶ月間、推論能力の深化とGPUの効率的な利用が、AI分野における主流の発展となってきました。私たちのFoxBrainモデルは、計算能力を盲目的に蓄積するのではなく、トレーニングプロセスを最適化することに焦点を当てた非常に効率的なトレーニング戦略を採用しました」と、Hon Hai研究所の人工知能研究センター所長であるリー・ユンフイ博士は述べました。「慎重に設計されたトレーニング方法とリソースの最適化を通じて、強力な推論能力を持つローカルAIモデルを成功裏に構築しました。」

FoxBrainのトレーニングプロセスは、NVIDIA H100 GPUsによって支えられ、NVIDIA Quantum-2 InfiniBandネットワーキングでスケールされ、約4週間で完了しました。最近市場に投入された推論モデルと比較して、より効率的で低コストなモデル訓練方法は、台湾のAI技術の発展に新たなマイルストーンを打ち立てました。

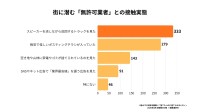

FoxBrainは、70Bパラメータを持つMeta Llama 3.1アーキテクチャに基づいています。TMMLU+テストデータセットのほとんどのカテゴリにおいて、同じスケールのLlama-3-Taiwan-70Bを上回り、特に数学と論理的推論において優れた性能を発揮しています(FoxBrainのTMMLU+ベンチマークについてはFig.1を参照してください)。以下はFoxBrainの技術仕様とトレーニング戦略です。

- 独自の技術を通じて24のトピックカテゴリのデータ拡張方法と品質評価を確立し、伝統的な中国語の高品質な事前トレーニングデータとして98Bトークンを生成しました。

- コンテキストウィンドウの長さ: 128Kトークン

- トレーニングに120台のNVIDIA H100 GPUを使用し、総計2,688 GPU日分の計算コストがかかりました。

- 高性能と安定性を確保するために、マルチノード並列トレーニングアーキテクチャを採用しました。

- 独自の適応的推論反射技術を使用して、モデルを自律的推論に訓練しました。

テスト結果では、FoxBrainはベースのMeta Llama 3.1モデルと比較して数学において包括的な改善を示しました。台湾Llamaと比較して数学テストで大きな進展を遂げ、現在の最良の伝統的な中国語大規模モデルである台湾Llamaを超え、同じクラスのMetaの現在のモデルを数学的推論能力で上回りました。DeepSeekの蒸留モデルにはまだわずかな差がありますが、その性能はすでに世界のトップレベルに非常に近いです。

FoxBrainの開発は、データ収集、クリーニング、拡張から、継続的事前学習、教師ありファインチューニング、RLAIF、適応推論反映に至るまで、独立した研究を通じて段階的に行われ、限られた計算リソースにもかかわらず、世界クラスのAIモデルに近い利益を達成しました。この大規模言語モデルの研究は、台湾の技術者がAIモデル分野で国際的な競争相手と競えることを示しています。

FoxBrainは当初、グループ内のアプリケーション用に設計されていましたが、今後、グループはテクノロジーパートナーと協力してFoxBrainのアプリケーションを拡大し、オープンソース情報を共有し、製造、サプライチェーン管理、インテリジェントな意思決定におけるAIの普及を促進していく予定です。

モデルのトレーニング中、NVIDIAは台北-1スーパーコンピュータと技術相談を通じてサポートを提供し、Hon Hai Research InstituteがNVIDIA NeMoを使用してモデルの事前トレーニングを成功裏に完了できるようにしました。FoxBrainは、Foxconnの三大プラットフォームのアップグレードを推進する重要なエンジンにもなるでしょう。スマート製造、スマートEV、スマートシティ。

FoxBrainの結果は、NVIDIA GTC 2025セッション「オープンソースからフロンティアAIへ」で初めて主要な会議で共有される予定です。3月20日に「ファウンデーションモデルの構築、カスタマイズ、拡張」。

Hon Hai研究所について

その研究所には5つの研究センターがあります。各センターには平均40名のハイテクR&D専門家がおり、全員が新技術の研究開発、フォックスコンの技術と製品の革新パイプラインの強化、グループの「腕力」から「頭脳」への変革を支援する取り組み、フォックスコンの「3+3」戦略の競争力強化に注力しています。

Foxconnについてはこちらをご覧ください。